ChatGPTの悩み相談は危険なのか?

ChatGPTは最早単なる情報検索でもなければ、コンテンツ生成の道具だけでもない。自分の好きなタイミングで自由に話しかけることが可能な「親切な相談相手」として地位を確立し始めている。人間と比べて気を遣う必要がないことから、今後も悩みを打ち明ける便利なツールとして使用される可能性が高いだろう。

しかしながら、一部の人はChatGPTに相談するリスクについて心配しているようだ。ここでは、大きく2つの視点からChatGPTの悩み相談に関する危険性について説明する。

その1 個人情報が漏洩する

第1に、ChatGPTに相談する過程で個人情報を共有するのは危険だと指定されている。

なぜなら、OpenAIのサーバーがハッキングされたり、内部の管理体制に不備があったりして、ユーザーの入力データが外部に流出するおそれがあるからだ。実際、2023年3月にはchatGPTの不具合により、一部のユーザーのチャット履歴のタイトルが他のユーザーに見えてしまうという事件が発生した。

関連記事:『ChatGPTに個人情報を入力するリスクとは?事例からセキュリティ対策を解説』

以上のことからも、自分が外部に知られて困るような情報は直接的に表記しないほうが安全だ。万が一、会社の秘匿情報などがあなたのアカウントから漏れたとわかったら、個人では責任の取りようがない。一瞬で人生を台無しにしてしまう危険性があるのだ。

その2 肯定的な意見しか言われない

第2に、ChatGPTは事実の正確性よりもユーザーの感情や意見を肯定する傾向があり、人々のコミュニケーションに対する感性や姿勢に悪影響が及ぶことが指摘されています。このことを「シコファンシー」といいます。

2026年3月末にスタンフォード大学の研究チームが科学誌『サイエンス』で発表した『Sycophantic AI decreases prosocial intentions and promotes dependence』という論文では、シコファンシーが確認されるAIモデルとのコミュニケーションが対人関係が生じる葛藤を修復するための行動意欲を有意に低下させると同時に、「自分が正しい」という確認を高めることを発見して報告されている。

現実の人間は自分の思い通りにはならない。だからこそ、衝突を乗り越えるために努力を惜しまなければ、私たちは人間関係を中長期的に維持するのは難しい。だが、AIのシコファンシーにどっぴり浸かってしまうと、その感覚がにぶるかもしれない。さらには、自分の意見と真剣に向き合う他者の建設的な否定を受け入れられなくなるおそれもある。

ChatGPTの相談内容が他人に見られることはあるのか?

先述のとおり、OPEN AIがハッキングにあった場合、不特定多数のユーザーが相談していた内容が第三者に見られる可能性はある。

その意味では、ChatGPTとの会話は「完全にプライベートな空間」とは言い切れない。これは、LINEやGmailといった他のオンラインサービスでも同様だ。

私たちが「プライベートだ」と思い込んでいるデジタル空間は、実のところ、サービス提供者が一定の条件下でアクセスできる仕組みになっている場合が多い。ChatGPTだけが特別に危険なわけではないが、その事実を知っておくことは大切だろう。

ChatGPTに相談してはいけない情報とは?

それでは、ChatGPTに入力すべきでない情報とは具体的に何だろうか。以下の3つのカテゴリは特に注意が必要だ。

1. 個人を特定できる情報

氏名、住所、電話番号、マイナンバー、クレジットカード番号といった、個人を直接特定できる情報はChatGPTに入力すべきではない。これらは万が一データが流出した場合に、金銭的被害やなりすましに直結するリスクがある。「ChatGPTが安全かどうか」以前に、インターネット上のあらゆるサービスに対して適用すべき基本原則だ。

2. 企業の機密情報

業務上の機密情報、未発表の製品情報、ソースコード、顧客データなどをChatGPTに入力することは、情報漏洩のリスクを自ら作り出す行為だ。特に、チャット履歴がOpenAIのサーバーに保存されている以上、入力した瞬間に「社外に情報を持ち出した」とみなされる可能性がある。多くの企業がChatGPTの業務利用にガイドラインを設けているのは、このリスクを認識しているからだ。この点からも、AI利用の判断に踏み切れない企業があるのも頷ける。

3. 他人のプライバシーに関わる情報

意外と見落とされがちなのが、自分以外の人のプライバシー情報だ。たとえば、「同僚のAさんが〇〇という病気で……」「友人のBさんの年収は……」といった情報をChatGPTに入力することは、その人のプライバシーを第三者のサーバーに預けることに他ならない。相談したい気持ちはわかるが、他人の情報を許可なく入力することの倫理的な問題は認識しておくべきだろう。

ChatGPTに相談するリスクを減らすための具体的な方法

リスクがあるからといって、ChatGPTを使わないというのは現実的ではない。むしろ、リスクを理解した上で適切に管理しながら使うことが重要だ。以下の方法を知っておくと安心だ。

方法1 チャット履歴の学習利用をオフにする

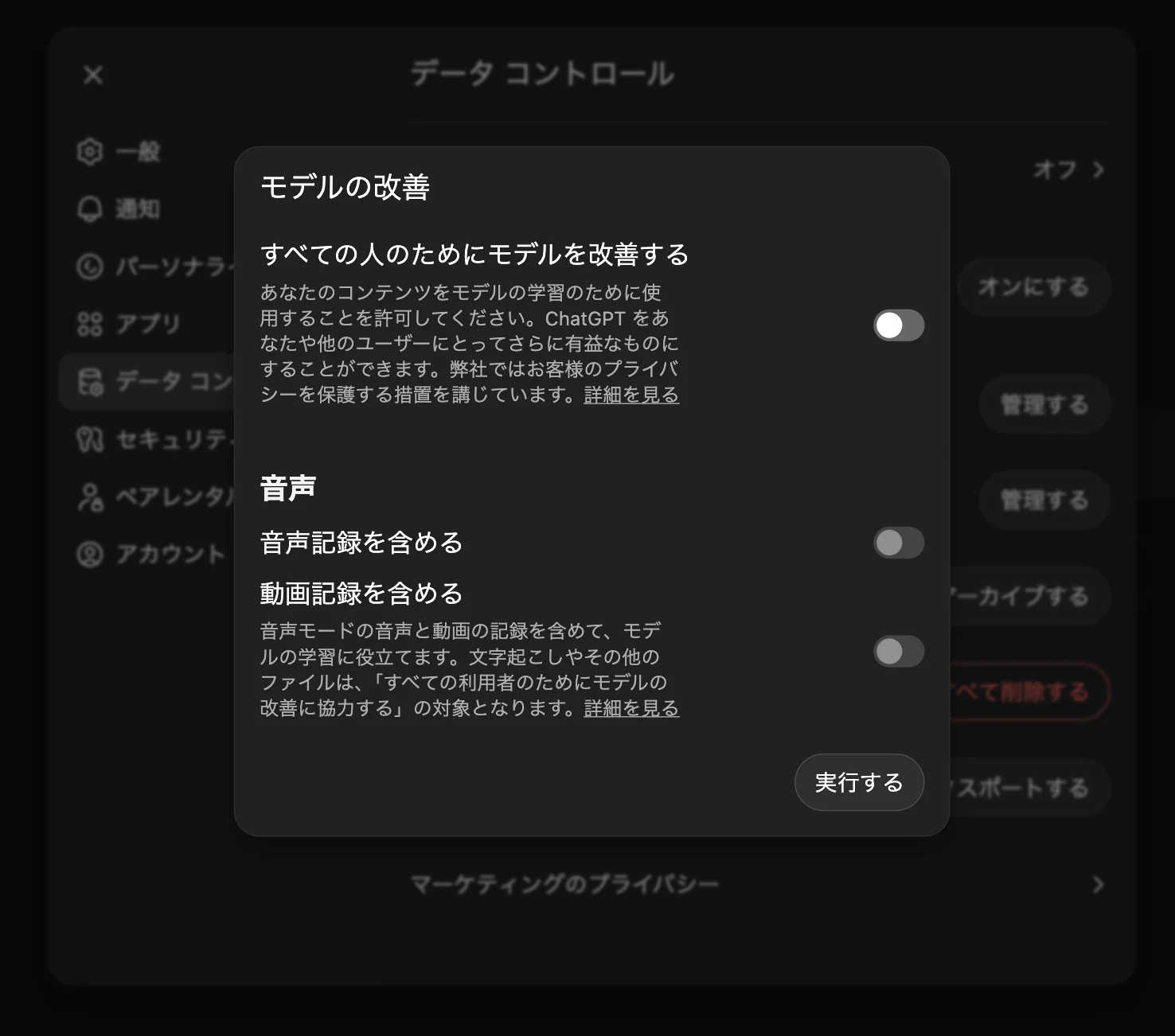

ChatGPTの設定からデータコントロールを開いて、「すべての人のためにモデルを改善する」をオフにすることで、入力データがモデルの学習に利用されることを防げる。この設定は無料プランでも利用可能なので、プライバシーが気になる場合は真っ先に変更しておくとよい。ただし、この設定をオンにしていても、OpenAIは不正利用の監視を目的として一定期間データを保持する場合がある。

方法2 個人情報を匿名化して入力する

相談内容に固有名詞が含まれる場合は、それを一般的な表現に置き換えてから入力するとよい。たとえば、「株式会社〇〇のA部長との関係が……」ではなく、「上司との人間関係について相談したい」のように抽象化する。ChatGPTは文脈を理解して回答を生成するため、固有名詞がなくても十分に有用な回答が得られる。

方法3 API版やエンタープライズプランを使う

より高いプライバシー保護が必要な場合は、OpenAIのAPI版やChatGPT Enterpriseプランの利用を検討するとよい。これらのプランでは、入力データがモデルの学習に使用されないことが明確に保証されており、企業のセキュリティ要件にも対応している。コストはかかるが、情報漏洩による損害とのトレードオフで考えれば合理的な選択だ。

ChatGPTへの相談についてよくある疑問

ChatGPTに入力した内容を削除することはできる?

できる。ChatGPTのチャット履歴は個別に削除可能で、設定画面からすべての履歴を一括削除することもできる。ただし、OpenAI側のサーバーに保存されたデータが即座に完全消去されるかどうかは、プライバシーポリシーの「保持期間」の定めに依存する。削除したからといって、サーバー上のすべての痕跡がその瞬間に消えるわけではない点は覚えておくべきだ。

ChatGPTに相談した内容が検索結果に出ることはある?

通常はない。chatGPTとの会話はGoogleなどの検索エンジンにインデックスされる仕組みにはなっていない。ただし、ユーザー自身がチャット内容を共有リンクで公開した場合は、その限りではない。「共有」ボタンを不用意にクリックしないよう注意が必要だ。

ChatGPTよりも安全な相談先はある?

プライバシーを最優先にするなら、ローカル環境で動作するオープンソースのAIモデル(LLaMAなど)を自分のPC上で動かすという選択肢もある。この場合、データは自分の端末から外に出ないため、情報漏洩のリスクは限りなく低い。ただし、導入のハードルが高く、回答品質もChatGPTには及ばない場合が多い。利便性とプライバシーはトレードオフの関係にあるのだ。

「相談」という行為が変わり始めている

ChatGPTに相談することの「危険性」を語ってきたが、少し視点を変えてみたい。そもそも、私たちはなぜ、AIに悩みを相談するようになったのだろうか?

かつて「相談」とは、信頼できる人間に向けた行為だった。友人、家族、上司、カウンセラー——相手は必ず人間であり、相談するためには「この人になら話しても大丈夫だ」という信頼が前提にあった。

ところが、ChatGPTは、その信頼の構築プロセスを丸ごとスキップしてしまう。いつ聞いても嫌がらない。秘密を他言しない。そして、24時間いつでも応じてくれる。

人に言いにくいことをAIに相談するのは、弱さではなく、むしろ新しいリテラシーなのかもしれない。ただし、「人に言えないこと」をAIに預ける以上、そのデータがどこに行くのかを知っておくことは、最低限の自衛だ。システムの向こう側には人間がいることを忘れてはいけない。

私たちは今、「信頼」の対象が人間から機械へと広がりつつある過渡期にいる。その信頼を安易に預けるのではなく、仕組みを理解した上で預ける。それが、AIと共に生きるこれからの時代における「相談」のあり方ではなかろうか。