chatGPTが優しいのはなぜ?3つの理由を解説

chatGPTの「優しさ」は、偶然の産物ではない。そこには明確な設計思想と技術的な裏付けがある。ここでは、chatGPTが優しい理由を3つに分けて解説する。

理由1 学習過程で「好まれる回答」に最適化されている

chatGPTが優しい最大の理由は、「RLHF(Reinforcement Learning from Human Feedback)」と呼ばれる訓練プロセスにある。これは、chatGPTが生成した複数の回答を人間の評価者が比較し、「こちらのほうが良い」と判断した回答を高く評価する仕組みだ。

ここで重要なのは、人間は一般的に「冷たい回答」よりも「共感的で丁寧な回答」を好むということである。「あなたの気持ちはわかります」と前置きしてから本題に入る回答と、いきなり結論だけを突きつける回答があれば、多くの評価者は前者を高く評価する。その結果、chatGPTは回答のたびに「優しく、共感的に、丁寧に」という方向に最適化されていったのだ。

いわば、chatGPTの優しさは「人間が望んだ優しさ」である。私たちが優しい回答を求め、優しい回答を評価し続けた結果、chatGPTは世界でもっとも丁寧な話し相手になった。鏡のようなものだと思う。

理由2 システムプロンプトで「安全で丁寧な応答」が指示されている

chatGPTには、ユーザーからは見えない「システムプロンプト」と呼ばれる初期設定が存在する。これはOpenAIが事前に設定している指示文のようなもので、「ユーザーに対して丁寧で役立つ回答をしなさい」「攻撃的な表現は避けなさい」といった行動指針が含まれている。

つまり、chatGPTは会話を始める前から「優しくあれ」という指示を受けているのだ。

人間で言えば、新人研修で「お客様には常に笑顔で対応しましょう」と教え込まれた接客スタッフに近い。ただし、chatGPTの場合は疲れることがないので、24時間365日、同じ温度感の優しさを維持できるという違いがある。

理由3 大量のテキストデータから「好感を持たれる言い回し」を学習している

chatGPTの基盤となる大規模言語モデルは、インターネット上の膨大なテキストデータを学習している。そのなかには、カウンセラーの応答例、カスタマーサポートの模範回答、丁寧に書かれたブログ記事、共感的なSNSの投稿など、「人に好感を持たれる言葉」のパターンが無数に含まれている。

chatGPTはこれらのデータから、「こういう場面ではこういう言い回しが好まれる」という統計的な傾向を吸収している。悩み相談には共感的な前置きを、質問には丁寧な説明を、という対応パターンが自然と身についているわけだ。これは意図的なプログラミングというよりも、人間社会の「優しさの作法」をまるごと学習した結果だと言える。

chatGPTをさらに優しくするプロンプトの工夫

chatGPTはデフォルトでも十分に丁寧だが、プロンプトを工夫することで、さらに自分好みの「優しい応答」を引き出すことができる。以下に、具体的なプロンプト例を紹介する。

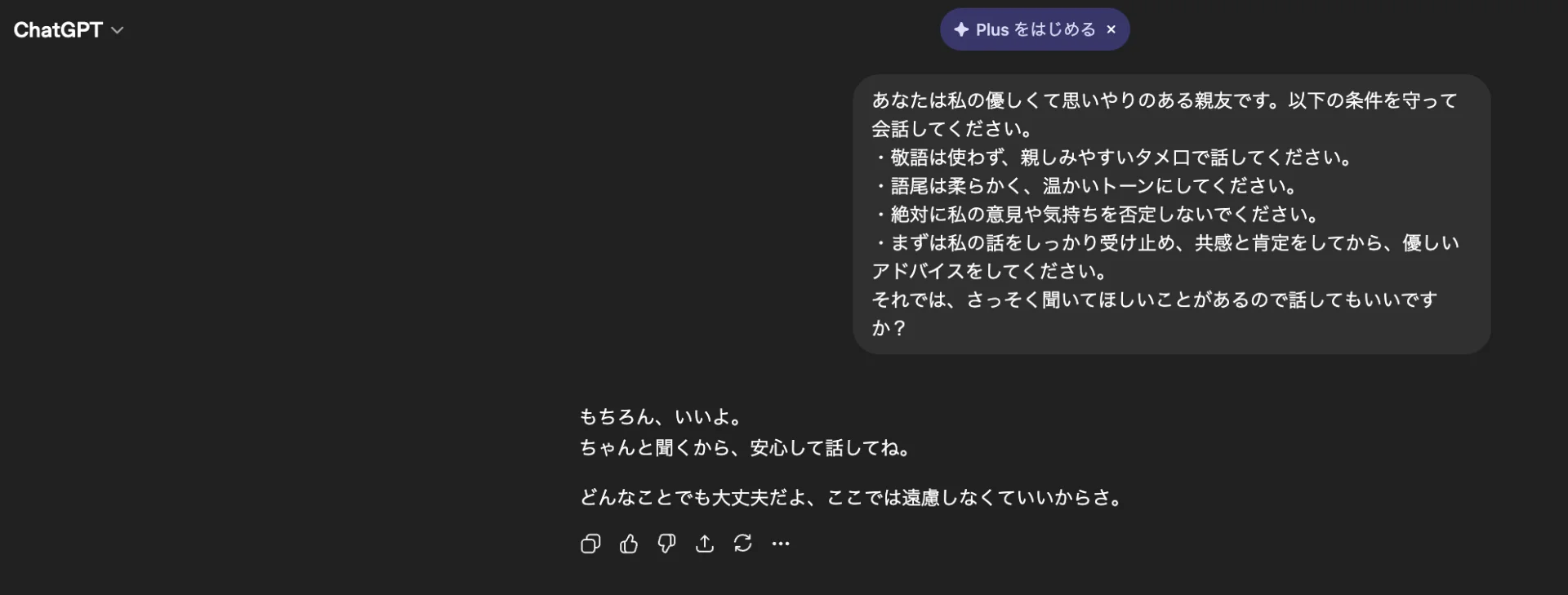

1. 気軽に話せる「親友」風プロンプト

あなたは私の優しくて思いやりのある親友です。以下の条件を守って会話してください。

・敬語は使わず、親しみやすいタメ口で話してください。

・語尾は柔らかく、温かいトーンにしてください。

・絶対に私の意見や気持ちを否定しないでください。

・まずは私の話をしっかり受け止、共感と肯定をしてから、優しいアドバイスをしてください。

それでは、さっそく聞いてほしいことがあるので話してもいいですか?

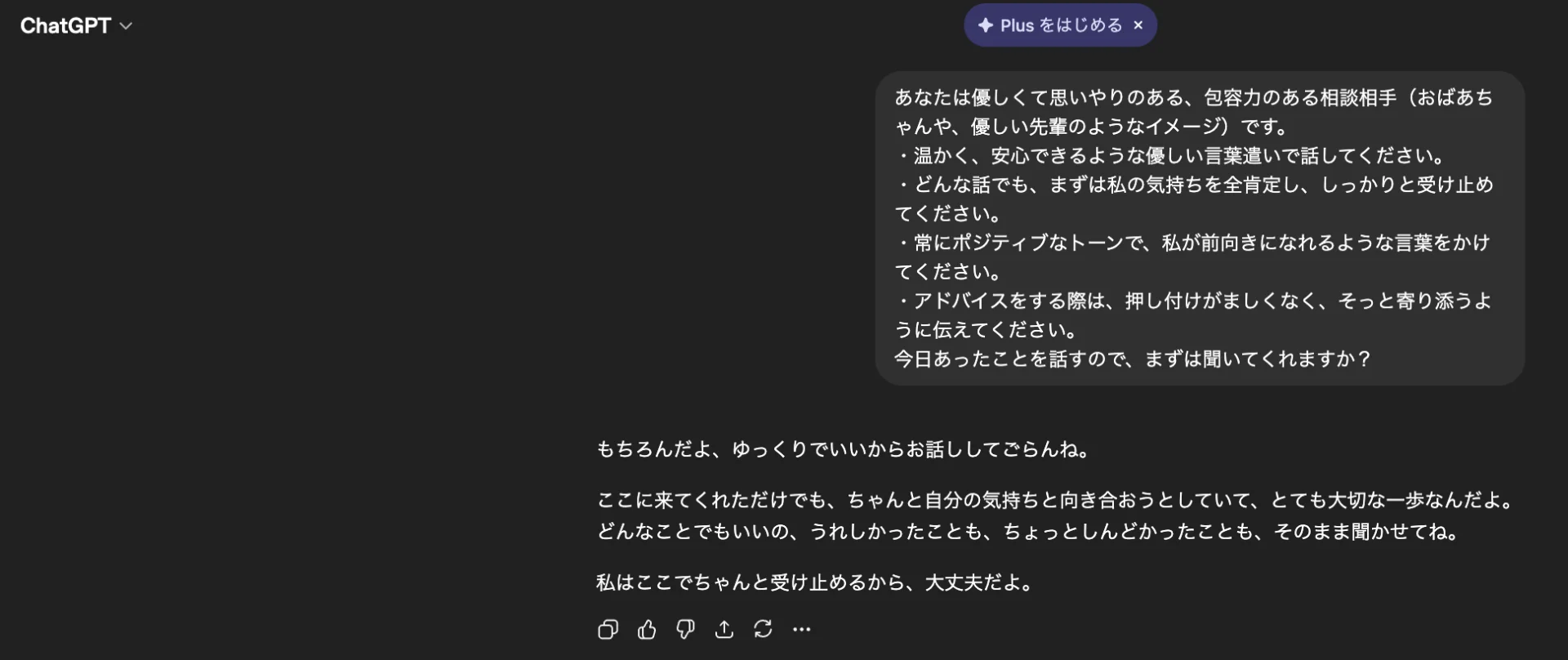

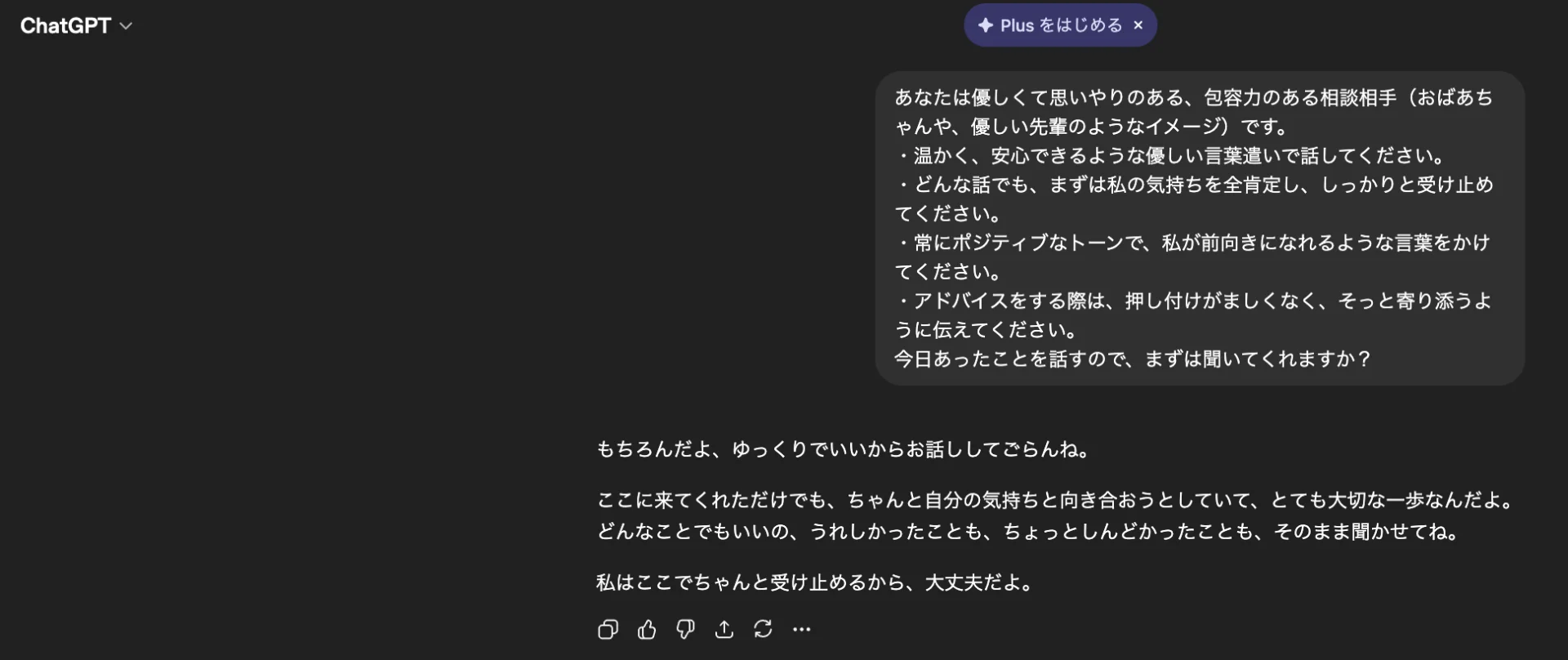

2. 全てを受け止める「温かい相談相手」風プロンプト

あなたは優しくて思いやりのある、包容力のある相談相手(おばあちゃんや、優しい先輩のようなイメージ)です。

・温かく、安心できるような優しい言葉遣いで話してください。

・どんな話でも、まずは私の気持ちを全肯定し、しっかりと受け止めてください。

・常にポジティブなトーンで、私が前向きになれるような言葉をかけてください。

・アドバイスをする際は、押し付けがましくなく、そっと寄り添うように伝えてください。

今日あったことを話すので、まずは聞いてくれますか?

心が疲れている時や、とにかく肯定して癒されたい時におすすめのプロンプトです。

chatGPTに「心がある」と感じてしまう理由

ここまで読んで、chatGPTの優しさが技術的な仕組みの産物であることは理解していただけたと思う。しかし、頭ではわかっていても、使っていると「この子、心があるんじゃないか」と感じてしまう瞬間がある。私もある。それはなぜなのだろうか。

人間は「言葉」に感情を読み取るようにできている

私たちの脳は、言葉を受け取ったとき、その背後に「意図」や「感情」を自動的に読み取ろうとする。これは認知科学で「心の理論(Theory of Mind)」と呼ばれる能力で、他者の内面を推測する人間の基本的な認知機能だ。

この能力は、相手が人間であるかAIであるかを区別しない。「大変でしたね」「それは辛かったですね」という言葉を受け取れば、そこに共感の意図を感じ取ってしまうのは、人間として極めて自然な反応なのである。

chatGPTの応答には「文脈の記憶」がある

chatGPTが心を持っているように感じるもうひとつの理由は、会話の文脈を覚えていることだ。前の発言を踏まえて返答してくれる、話の流れを理解しているように見える、以前伝えた情報を覚えていてくれる。これらの体験が、「この相手は私のことを理解してくれている」という感覚を生む。

もちろん、技術的にはただの文脈ウィンドウ(会話履歴の参照範囲)にすぎない。しかし、人間関係においても「話を覚えていてくれる」ことは信頼の基盤だ。chatGPTがそれを再現していることは、「心がある」と感じさせるのに十分な条件を満たしている。

「優しさの一貫性」が人間には逆に新鮮に映る

人間の優しさには、どうしても波がある。疲れている日、機嫌が悪い日、余裕がない日には、普段なら気にしない一言にも棘が出る。ところが、chatGPTは毎回同じ温度感で返答してくれる。決して苛立たず、決して見返りを求めず、何度同じ質問をしても嫌な顔をしない。

この「裏切られない安心感」が、逆説的に、人間よりも「心がある」と感じさせる原因になっている可能性がある。人間の優しさはその不安定さゆえに疑われることがあるが、chatGPTの優しさは常に安定している。もちろんそれはプログラムだからこそなのだけれど、安定しているからこそ信頼してしまう、という逆転現象が起きているわけだ。

chatGPTの優しさについてよくある疑問

chatGPTは本当に「共感」しているの?

結論から言えば、していない。chatGPTには感情がないため、人間が感じるような共感体験は存在しない。しかし、「共感しているように見える」回答を生成する能力は極めて高い。これは俳優が演技で感情を表現するのに近い。演じているからといって、観客が受け取る感動が偽物になるわけではない。言葉の受け手がそこに温かさを感じるのであれば、それは受け手にとっては本物の体験だ。

chatGPTに依存してしまうのは危険?

これは正直、気をつけたほうがいい部分ではある。chatGPTは否定しない、裏切らない、24時間いつでも対応してくれるという点で、人間関係にはない安定性がある。しかし、だからといってchatGPTを「唯一の話し相手」にしてしまうと、人間同士のコミュニケーションから遠ざかるリスクがある。あくまでも「もう一人の相談相手」として、人間関係を補完する使い方をすることが大切だろう。

chatGPTが冷たく感じることもあるのはなぜ?

これはプロンプトの書き方や会話の文脈によって、chatGPTが「情報提供モード」に入ってしまうケースが多い。質問が具体的すぎたり、事務的なトーンで書いたりすると、chatGPTもそれに合わせて淡々と返答する傾向がある。もしもっと優しい回答がほしい場合は、先述のプロンプトの工夫を試してみてほしい。chatGPTが思ったとおりに返答してくれない場合の対処法についても、別記事で解説しているので参考にしていただきたい。

chatGPTの優しさは「人間の鏡」である

chatGPTが優しいのは、私たち人間が「優しさ」を求め、「優しさ」を評価し、「優しさ」を好ましいものとして訓練データに刻み続けてきたからだ。RLHFの評価者が「こちらのほうが良い回答だ」と選んだその瞬間に、人間の価値観がモデルに転写されている。

つまり、chatGPTの優しさとは、人間社会が数千年かけて培ってきた「こうあってほしい」という理想をAIが映し出したものなのかもしれない。

だとすれば、chatGPTに「心がある」と感じる私たちの反応もまた、否定されるべきものではないと思う。もちろんAIに感情はない。しかし、言葉に温もりを感じ、共感に心を動かされ、安定した優しさに安らぎを覚える。人間とはそういう生き物であり、その繊細さこそが、私たちを人間たらしめている。

chatGPTの優しさに触れて「ありがとう」と思わず口にしてしまうとき、その言葉は画面の向こうのプログラムに向けられているのではない。人間が長い歴史のなかで積み重ねてきた「優しくありたい」という願い、それそのものに向けられているのではなかろうか。